Teknisk SEO: Hva Det Er Og Hvordan Du Fikser Det

Teknisk SEO er grunnmuren som gjør at alt annet SEO-arbeid faktisk virker. Uten riktig crawling, indeksering, ytelse og sikkerhet vil selv det beste innholdet forbli usynlig. Denne guiden går rett på det som betyr noe: hvordan man gjør nettstedet teknisk sunt, slik at Google raskt forstår innholdet, belønner brukeropplevelsen og – helt konkret – løfter trafikk og inntekter.

Hovedpoeng

- Teknisk SEO er fundamentet: sikre korrekt crawling og indeksering med riktig bruk av robots.txt, meta robots og rene XML‑sitemaps.

- Reduser frafall og løft rangeringer ved å forbedre Core Web Vitals (LCP < 2,5 s, INP < 200 ms, CLS < 0,1) gjennom bildeoptimalisering, slanking av CSS/JS, caching og CDN.

- Kontroller duplikater med rel=»canonical», konsistent internlenking og ryddige URL‑parametre for å samle autoritet på riktige sider.

- Bygg en mobil‑først informasjonsarkitektur med flatt hierarki og tydelige breadcrumbs, og bruk interne lenker og topic clusters til å styre crawl‑budsjett og relevans.

- Styrk tillit og synlighet med HTTPS/HSTS, korrekt statuskodebruk (200/301/404/410), validerte strukturerte data og kontinuerlig overvåking via Search Console, logganalyse og crawlere.

Hva Er Teknisk SEO?

Forskjellen Mellom Teknisk, On-Page Og Off-Page

Teknisk SEO handler om selve infrastrukturen: hvordan nettstedet er bygget, levert og gjort tilgjengelig for søkemotorer og brukere. Det inkluderer blant annet hastighet, sikkerhet, URL-struktur, crawling/indeksering, mark-up og feilhåndtering.

- On-page SEO fokuserer på innholdet: søkeordsrelevans, titler, meta, overskrifter, interne lenker og E‑E‑A‑T-signaler i teksten.

- Off-page SEO dreier seg om eksterne signaler som lenker, omtaler og autoritet.

De tre disiplinene henger sammen, men med teknisk SEO som fundamentet. Når strukturen er ren og rask, får innhold og lenker full effekt.

Hvordan Teknisk SEO Påvirker Synlighet Og Inntekt

Teknisk helse påvirker alt fra om en side blir indeksert til hvor høyt den rangerer. Rask lastetid, mobilvennlighet og stabil rendering reduserer frafall, øker konverteringene og gir tydelige kvalitets-signaler. I praksis betyr det:

- Flere riktige sider i indeks, færre feilindekseringer.

- Bedre Core Web Vitals → høyere synlighet og bedre brukeropplevelse.

- Mindre kanibalisering og duplikatrot → tydeligere rangeringer.

En robust teknisk plattform gjør hvert nye innholds- og lenketiltak mer lønnsomt.

Crawlability Og Indeksering

Robots.txt, Meta Robots Og Noindex

Crawlability starter med å styre hva roboter kan og bør besøke. Robots.txt setter rammene for crawling av kataloger og ressursfiler, mens meta robots og HTTP‑header‑direktiver (noindex, nofollow, noarchive m.m.) styrer indeksering på URL‑nivå. Best practice:

- Tillat nødvendige ressurser (JS, CSS, bilder) slik at Google kan rendre siden korrekt.

- Bruk noindex for svake eller dupliserte sider som likevel må eksistere (søk, filtrering, paginering).

- Ikke blokker sider i robots.txt hvis du vil at noindex skal virke – blokkerte sider blir ikke crawlet og får ikke lest meta‑taggen.

XML-Sitemaps, Prioritering Og Oppdagbarhet

Et oppdatert XML‑sitemap hjelper søkemotorer å oppdage viktige URL‑er raskt. Del opp i logiske mapper (innholdstyper), ta kun med kanoniske og indekserbare URL‑er, og oppdater ved endringer. Husk:

- Send sitemap i Search Console for raskere oppdagelse.

- Bruk lastmod for å signalisere endringer.

- Hold kvaliteten høy: Et sitemap er ikke en søppelbøtte, men en prioritert liste.

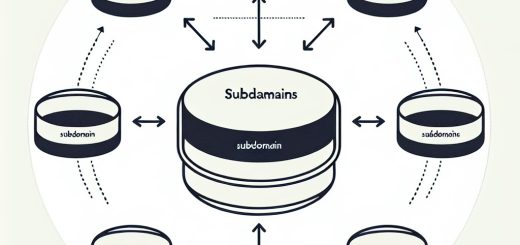

Kanoniske URL-Er, Parametre Og Duplikatinnhold

Der parametre, sortering og filtrering skaper mange URL‑varianter, oppstår duplikatinnhold. Løsningene er kombinasjoner av:

- rel=»canonical» som peker på originalen for like eller svært like sider.

- Konsistent internlenking til kanoniske adresser.

- Parameter‑hygiene (unngå unødvendige parametre, bruk statiske URL‑er der det lar seg gjøre).

Riktig canonical bruker signaliserer hvilken side som skal rangeres og motvirker fragmentert autoritet.

Ytelse Og Core Web Vitals

LCP, INP Og CLS: Hva De Betyr I Praksis

Core Web Vitals måler sann brukeropplevelse:

- LCP (Largest Contentful Paint): hvor raskt hovedinnholdet er synlig. Sikt på under 2,5 sekunder.

- INP (Interaction to Next Paint): hvor responsivt siden reagerer på interaksjoner. God er < 200 ms.

- CLS (Cumulative Layout Shift): visuell stabilitet. Hold under 0,1 for å unngå «hoppende» innhold.

Optimalisering her løfter både SEO og konvertering – to fluer i én smekk.

Raske Fikser: Bilder, CSS/JS, Caching Og CDN

De fleste gevinster kommer fra noen få grep:

- Bilder: bruk moderne formater (AVIF/WebP), riktig dimensjonering og lazy loading. Server ulike størrelser for mobil/desktop.

- CSS/JS: minifiser og fjern ubrukt kode. Utsett ikke-kritiske scripts, og prioriter kritisk CSS i head.

- Caching: aktiver HTTP‑cache og sett fornuftige cache‑tider. Implementer server‑side caching for dynamiske sider.

- CDN: lever statiske ressurser nær brukeren. Reduser avstand og runde‑tider, spesielt for internasjonal trafikk.

Server-Tuning: HTTP/2, TTFB Og Edge-Levering

Serveren setter tonen for alt annet. Oppgrader til HTTP/2 (og gjerne HTTP/3/QUIC der mulig), komprimer med Brotli, og optimaliser TTFB via:

- Effektiv database‑indeksering og query‑caching.

- PHP/Node‑versjoner oppdatert til nyeste stabile.

- Edge‑rendering eller edge‑cache på CDN for tunge sider.

Lav TTFB gjør alt raskere – fra første byte til ferdig render.

Mobil, IA Og Internlenking

Mobil-First-Indeksering Og Responsivt Design

Google vurderer i praksis mobilversjonen først. Et responsivt design med samme innhold og interne lenker som desktop er kritisk. Unngå skjulte elementer som bare finnes på desktop, sørg for lesbar typografi, og test klikkmål og interaksjoner på små skjermer.

Informasjonsarkitektur: Flatt Hierarki Og Breadcrumbs

En ryddig IA hjelper både brukere og roboter. Et flatt nok hierarki (få klikk til viktige sider) og meningsfulle breadcrumbs gir kontekst og bedre crawling. Strukturer etter brukeroppgaver og tema, ikke organisasjonskart. Kort sagt: logiske seksjoner, konsistente URL‑mønstre, og klare hubs for hvert emne.

Internlenking For Crawl-Budsjett Og Relevans

Interne lenker styrer både oppdagelse og autoritet. Praktisk tilnærming:

- Lenke fra høyt trafikkerte sider til dype, viktige landingssider.

- Bruk beskrivende ankertekster som matcher hensikt og emne.

- Bygg emne‑klynger (topic clusters) rundt hovedsider for å signalisere ekspertise og dekning.

God internlenking sparer crawl‑budsjett og øker relevanssignaler.

Sikkerhet, Strukturerte Data Og Feilhåndtering

HTTPS, HSTS Og Mixed Content

Sikkerhet er et rangering- og tillitssignal. Kjør hele nettstedet over HTTPS, aktiver HSTS for å tvinge sikre tilkoblinger, og fjern mixed content (usikre ressurser lastet inn på sikre sider). Dette beskytter brukeren og eliminerer støy i Core Web Vitals relatert til blokkert innhold.

Strukturerte Data: Schema-Typer, Validering Og Rich Results

Strukturerte data hjelper søkemotorer å forstå innholdet og kvalifiserer for rich results. Bruk schema.org‑typer som passer (Article, Product, FAQ, HowTo, Organization, BreadcrumbList), og valider i Search Console og Rich Results Test. Hold data oppdatert og konsistent med synlig innhold – feil mark‑up kan skade mer enn den hjelper.

Statuskoder, 301-Redirects, 404/410 Og Canonicals

Ryddige statuskoder bevarer autoritet og brukerflyt:

- 200 for sider som skal rangeres.

- 301 ved permanente flyttinger og konsolidering av URL‑er.

- 404 for reelt borte innhold, 410 når innholdet er fjernet for godt.

- Canonical for å samle signaler ved overlappende innhold.

Unngå redirect‑kjeder og loop, og oppdater interne lenker til endelige mål.

Revidering, Overvåking Og Vanlige Feller

Verktøysett: Search Console, Logganalyse Og Crawlere

Bygg en fast rytme for tekniske revisjoner:

- Google Search Console for indekseringsstatus, CWV‑rapporter og feilmeldinger.

- Logganalyse for å se hvordan Googlebot faktisk crawler – ikke bare hva du håper den gjør.

- Crawl‑verktøy (for eksempel Screaming Frog, Sitebulb) for å avdekke brutte lenker, duplikater, tynne sider og blokkerte ressurser.

Prioritering Med Impact Vs. Effort Og Roadmapping

Ikke alt må fikses i dag. Rangér tiltak etter potensiell effekt og innsats. Start med tekniske hindringer som stopper indeksering eller gir store CWV‑tap, og legg en realistisk roadmap som teamet kan følge. Dokumenter hypoteser, mål og resultater – slik bygges forutsigbar SEO.

Vanlige Feller: Blokkerte Resurser, Render-Feil, Hreflang Og Orphan Pages

- Blokkerte resurser: CSS/JS sperret i robots.txt gir feil rendering og dårlig vurdering.

- Render‑feil: Tunge client‑side apper uten SSR/rehydrering kan gi tomt innhold ved crawl.

- Hreflang: Feil peking eller manglende retur‑tagger skaper kannibalisering på tvers av språk/land.

- Orphan pages: Sider uten interne lenker blir usynlige – og de forbruker likevel crawl‑budsjett.

Konklusjon

Teknisk SEO er ikke pynt – det er fundamentet. Når crawling, indeksering, ytelse, mobil, sikkerhet og datastruktur spiller på lag, får innholdet maksimal synlighet og bedre konvertering. Start med de store hindringene (indeksering og CWV), bygg en enkel IA med smarte interne lenker, og overvåk i Search Console. Resultatet er en raskere, renere og mer lønnsom tilstedeværelse i søk.

Ofte stilte spørsmål

Hva er teknisk SEO, og hvordan skiller det seg fra on-page og off-page?

Teknisk SEO handler om infrastrukturen: hastighet, sikkerhet, URL‑struktur, crawling/indeksering, mark‑up og feilhåndtering. On‑page fokuserer på innhold, titler og interne lenker, mens off‑page handler om lenker og omtaler. Når teknisk SEO er på plass, får innhold og lenker full effekt i søk.

Når bør jeg bruke robots.txt, meta robots og noindex?

Bruk robots.txt for å styre crawling av kataloger og ressurser, men ikke blokkér sider du vil noindexe. Meta robots (noindex/nofollow) brukes på URL‑nivå for svake eller dupliserte sider som må eksistere. Tillat CSS/JS/bilder for korrekt rendering og nøyaktig vurdering.

Hva er de raskeste måtene å forbedre Core Web Vitals (LCP, INP, CLS)?

Komprimer og dimensjoner bilder (WebP/AVIF), bruk lazy loading og server riktige størrelser. Minifiser og fjern ubrukt CSS/JS, utsett ikke‑kritiske scripts og lever kritisk CSS i head. Aktiver caching, bruk CDN, oppgrader til HTTP/2/3 og optimaliser TTFB med bedre database‑indeksering.

Hvor lang tid tar det før teknisk SEO-tiltak påvirker rangering og trafikk?

Effekter kan merkes innen dager–uker for indeksering og hastighetsforbedringer, mens stabile rangeringer ofte tar 4–12 uker avhengig av crawl‑frekvens, omfanget av endringer og konkurranse. Kritiske feilfikser (indeksering/CWV) gir ofte raskest utslag, men helhetlige gevinster akkumuleres over måneder.

Hvordan bør jeg strukturere og vedlikeholde et XML-sitemap for bedre indeksering?

Ta kun med kanoniske, indekserbare URL‑er og del opp per innholdstype. Bruk lastmod for å signalisere endringer og send sitemap i Google Search Console. Hold kvaliteten høy—ikke fyll med noindex/404. Oppdater ved endringer for raskere oppdagelse og renere indeks.

Hvor ofte bør jeg gjøre en teknisk SEO-revisjon, og hvilke områder bør prioriteres?

Gjennomfør en grunnrevisjon kvartalsvis og ved større lanseringer. Overvåk løpende i Search Console. Prioriter: indekseringsfeil, Core Web Vitals/TTFB, mobilvennlighet, statuskoder/redirects, kanoniske URL‑er, XML‑sitemaps, sikkerhet (HTTPS/HSTS) og internlenking. Start med feil som hindrer crawling eller gir store ytelsestap.